Dark Patterns: engañar al usuario

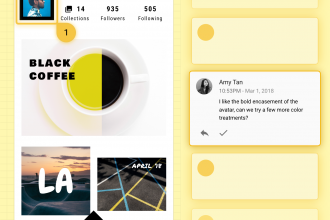

Al emplear servicios en Internet, realizar compras online o emplear apps de descarga gratuita, es común encontrarse con ventanas pop up que nos incitan a realizar una acción con mensajes poco claros, procesos de compra que tratan en colar gastos adicionales sin que nos demos cuenta, u opciones de subscripción a servicios o uso de datos personales que vienen pre-seleccionadas en formularios y páginas de confirmación. Todos estos elementos forman parte de lo que se conoce como dark patterns (patrones oscuros), estrategias de diseño de interfaces destinadas a lograr que el usuario realice una acción sin darse cuenta de ello o se vea en cierto modo coaccionado a realizarla.

El término fue acuñado en 2010 por el diseñador Harry Brignull, quien registró el sitio web darkpatterns.org, realizó una clasificación de tipos de patrones oscuros e inició un “Salón de la Vergüenza” (Hall of Shame) con ejemplos de estas prácticas por parte de todo tipo de empresas. Casi una década más tarde, el término ha adquirido mayor relevancia gracias a escándalos como el uso de datos de los usuarios y la manipulación de la información que estos reciben por parte de empresas como Facebook y Cambridge Analytica. La nueva ley de protección de datos en la Unión Europea forma parte de los esfuerzos que se están realizando para controlar prácticas abusivas y proteger a los ciudadanos en un contexto en el que son particularmente vulnerables.

Un porcentaje cada vez mayor de la población en los países industrializados emplea servicios contratados a través de plataformas web y realiza compras online, suministrando sus datos personales y dando acceso a sus cuentas bancarias. Pero la mayoría desconoce las consecuencias de facilitar esta información y basa sus acciones en una mezcla de confianza ciega y pereza. La interacción con un formulario de suscripción, una ventana pop up o un carrito de la compra online está motivada por el deseo de obtener un servicio, acceder a una página o adquirir un producto. Este deseo genera impaciencia, a la que se suman las constantes distracciones a las que nos vemos sometidos al emplear dispositivos digitales, particularmente smartphones. Esto supone que el usuario quiere una interacción rápida y que va dedicar poco tiempo a examinar la información que se le presenta, guiándose por elementos gráficos evidentes, tales como grandes botones de colores o frases subrayadas en rojo. Los diseñadores que emplean patrones oscuros aprovechan esta interacción distraída e impaciente para engañar al usuario.

Brignull identifica once tipos de patrones oscuros que conducen al usuario a realizar determinadas acciones sin tener conocimiento de ello o bajo una cierta coacción:

- Bait and switch (tirar el anzuelo y modificar la acción): el usuario se propone realizar una acción, motivado a menudo por un mensaje de alerta, pero acaba realizando otra porque se le presenta una información engañosa. Un ejemplo de ello es un mensaje de alerta de Windows en el que se “animaba” a los usuarios a actualizar el sistema operativo a Windows 10. El botón de la esquina superior derecha de la ventana, con una X, que habitualmente sirve para cerrar la ventana, se cambió por la acción de actualizar a Windows 10 automáticamente.

- Confirmshaming (forzar la confirmación por medio de la culpa): esta técnica consiste en redactar el texto de los botones (o enlaces) en un mensaje de manera que el usuario se vea forzado a seleccionar la opción que más conviene a la empresa. Por ejemplo, un mensaje de Amazon invita al usuario a comprar un producto por un precio reducido e incluye los botones “comprar ahora” y “no, no quiero ahorrar dinero.”

- Disguised Ads (anuncios disfrazados): tal vez una de las técnicas más habituales, que también se puede ver en publicaciones en papel, es la de disfrazar un anuncio como parte del contenido de un sitio web, empleando la misma tipografía y colores. En ocasiones, estos anuncios pueden colarse en un proceso de compra o reserva, disfrazados como parte del mismo proceso (por ejemplo, en la página de confirmación) aunque en realidad llevan al usuario a realizar otra compra.

- Forced Continuity (continuidad forzada): un recurso popular en los servicios por suscripción, consiste en facilitar el acceso al servicio por medio de una “prueba gratuita” en la que no obstante hay que facilitar los datos de la tarjeta de crédito. El período de prueba gratuito suele ser lo bastante largo (15 días a 2 meses) como para que el usuario se “enganche” al servicio u olvide que lo ha contratado y luego pasa a renovarse automáticamente, con cargos regulares a la tarjeta de crédito.

- Friend Spam (spam de amigos): muchas redes sociales ofrecen al usuario, en el momento de inscribirse, la posibilidad de buscar automáticamente a sus amigos empleando su lista de contactos. El resultado es que la empresa usa estos datos para enviar emails a los contactos sin el permiso del usuario. El caso más conocido es el de LinkedIn, que acabó con una denuncia y el pago de una multa de 13 millones de dólares en 2015.

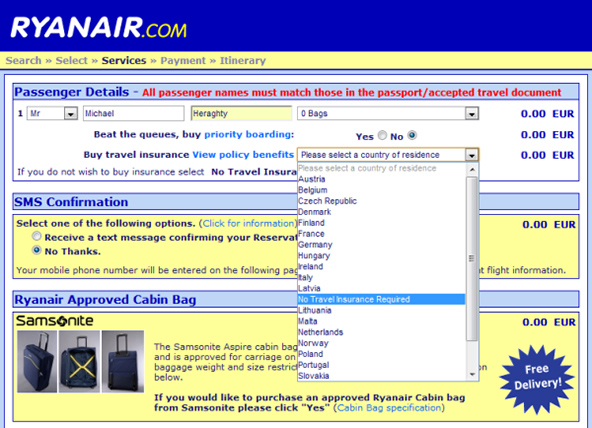

- Hidden Costs (costes ocultos): algunas empresas incluyen en el proceso de compra costes que no estaban declarados previamente, en ocasiones ocultándolos hasta el momento mismo en que se confirma la compra. La aerolínea Ryanair es conocida por haber iniciado la práctica de promocionar sus vuelos a precios muy bajos, que se van incrementando a medida que el consumidor lleva a cabo el proceso de compra y debe pagar por escoger asiento, llevar la maleta en la cabina del avión o emplear determinadas tarjetas de crédito, además de una gran cantidad de servicios adicionales que se le ofrecen y debe rechazar individualmente hasta llegar a la página de confirmación de compra.

- Misdirection (malaconsejar o redirigir): esta forma de engaño consiste en presentar la información de manera que parezca algo que no es, a menudo para convencer al usuario de que escoge la opción más ventajosa cuando no es así. Un ejemplo aportado por Brignull es el de la aerolínea Jetstar, que ofrece al usuario un asiento “pre-seleccionado” por $5, mientras que existe la opción de obtener un asiento aleatorio gratis. Para el usuario, es lo mismo obtener un asiento “pre-seleccionado” o aleatorio puesto que la empresa decide por él, pero en el primer caso además paga $5.

- Price Comparison Prevention (prevención de la comparación de precios): por medio de la manipulación de la información, es posible evitar que el usuario pueda comparar entre los precios de dos productos. Un ejemplo de ello es la presentación de dos productos con diferentes criterios de precio, por ejemplo manzanas con un precio por kilo o por unidad, o la comparación entre dos tipos de suscripciones cuando una se paga mensualmente y la otra anualmente. En este último caso, es frecuente que se anuncie una cuota mensual de precio inferior, indicando posteriormente o en letra pequeña que dicha cuota se aplica sólo si se contrata el servicio durante un año, y se paga la cuota anual por adelantado.

- Privacy Zuckering (“zuckerización” de la privacidad): en referencia al director ejecutivo de Facebook, Mark Zuckerberg, este patrón oscuro consiste en engañar al usuario para que facilite más información personal de la deseada. Es conocido que Facebook ha facilitado a menudo la difusión de más información privada de la que los usuarios querían publicar, lo que ha llevado a introducir herramientas y normas más claras que facilitan el control de los contenidos publicados. Con todo, el negocio del uso de los datos de los usuarios continúa siendo provechoso y es frecuente que las empresas incluyan opciones pre-seleccionadas que les permitan compartir los datos del usuario con otras “empresas afiliadas.” También es notable que algunas plataformas de acción social incluyen por defecto la opción de compartir la petición en redes sociales y que esta aparece un poco después de cargar la página, de manera que el usuario puede hacer clic en el botón de firma sin darse cuenta que está publicando la petición en Facebook.

- Roach Motel (motel de cucarachas): al pagar por una habitación en un hotel de muy baja calidad, uno puede encontrarse con que incluye “extras” no deseados tales como cucarachas o chinches. De manera similar, algunos servicios en Internet tratan de “colar” suscripciones en el proceso de compra, aprovechando que disponen de los datos de la tarjeta de crédito del usuario. Según Brignull, empresas como Ticketmaster han empleado esta técnica en su proceso de compra de entradas, incluyendo la opción pre-seleccionada de una suscripción a una revista de música.

- Sneak into Basket (colarse en la cesta): de forma similar a otras técnicas descritas anteriormente, este patrón oscuro consiste en añadir costes en el proceso de compra por medio de opciones pre-seleccionadas o preguntas trampa.

- Trick Questions (preguntas trampa): en este caso se trata de redactar determinadas opciones o preguntas de manera que parezcan afirmar lo contrario de lo que afirman. Por ejemplo, en un formulario de suscripción, el usuario puede encontrarse con dos casillas por marcar. En la primera pone “Por favor no me envíen mensajes de EmpresaY.com” y en la segunda “Por favor envíenme mensajes de empresas recomendadas por EmpresaY.com”. En una lectura rápida, se asume que ambas casillas deben marcarse para no recibir spam, pero la segunda opción permite a la EmpresaY vender los datos del usuario.

En este menú de la web de Ryanair se fuerza al usuario a comprar un seguro de viaje. La opción para descartar el seguro está escondida en la lista de países.

Estas técnicas son las más frecuentes, pero existen otras formas de manipular a los usuarios, algunas muy evidentes y otras más sutiles. Por ejemplo, en los videojuegos de descarga gratuita para dispositivos móviles es frecuente emplear la publicidad como recurso con el que interrumpir la experiencia del jugador y forzarle a comprar una versión del juego sin anuncios, o bien seducirle constantemente con la compra de ítems o monedas propias del juego para poder progresar en el mismo.

Como señala Natasha Lomas en un artículo publicado recientemente en TechCrunch, los patrones oscuros tienen hoy en día más vigencia que nunca y suponen una cuestión a considerar seriamente, tanto en relación a la ética del diseño como a la imagen de una empresa y sus beneficios a largo plazo. Brignell afirma que el uso de patrones oscuros es “la punta del iceberg” de una cultura empresarial poco ética, y en este sentido no es de extrañar que las grandes empresas se hayan enfrentado a pleitos y multas millonarias por este motivo. Con todo, las multas en sí no sirven para cambiar la ética de las empresas, que en muchas ocasiones considerarán que vale la pena arriesgarse a negociar una compensación económica.

Los patrones oscuros funcionan bien a nivel superficial, en cuanto permiten a las empresas obtener beneficios de las acciones descuidadas o mal informadas de los usuarios. Pero a la larga los usuarios se dan cuenta de que han sido engañados y ello comporta una mala imagen para la empresa, que además pierde la confianza del consumidor. La experiencia y las limitaciones actuales de estos patrones nos hace ser más cautos para evitar caer en trampas que a menudo cuestan dinero. Con todo, el desarrollo de la Inteligencia Artificial y la capacidad para elaborar perfiles más precisos de cada usuario plantea nuevos retos, puesto que seguramente se crearán patrones oscuros que será más difícil detectar o se aplicarán sólo a determinados usuarios. Contrarrestar su efecto requerirá, por una parte, de diseñadores con un mayor sentido de la ética, y por otra, de usuarios más alerta.